아이폰 이후 다음 10년 전략이 보이는 이유

요즘 AI 하드웨어 얘기 많잖아. 그런데 이번에 나온 소식은 단순 신제품 루머 느낌이 아니라, 애플이 어떤 방향으로 생태계를 확장하려는지 꽤 또렷하게 보여줘서 정리해봤어.

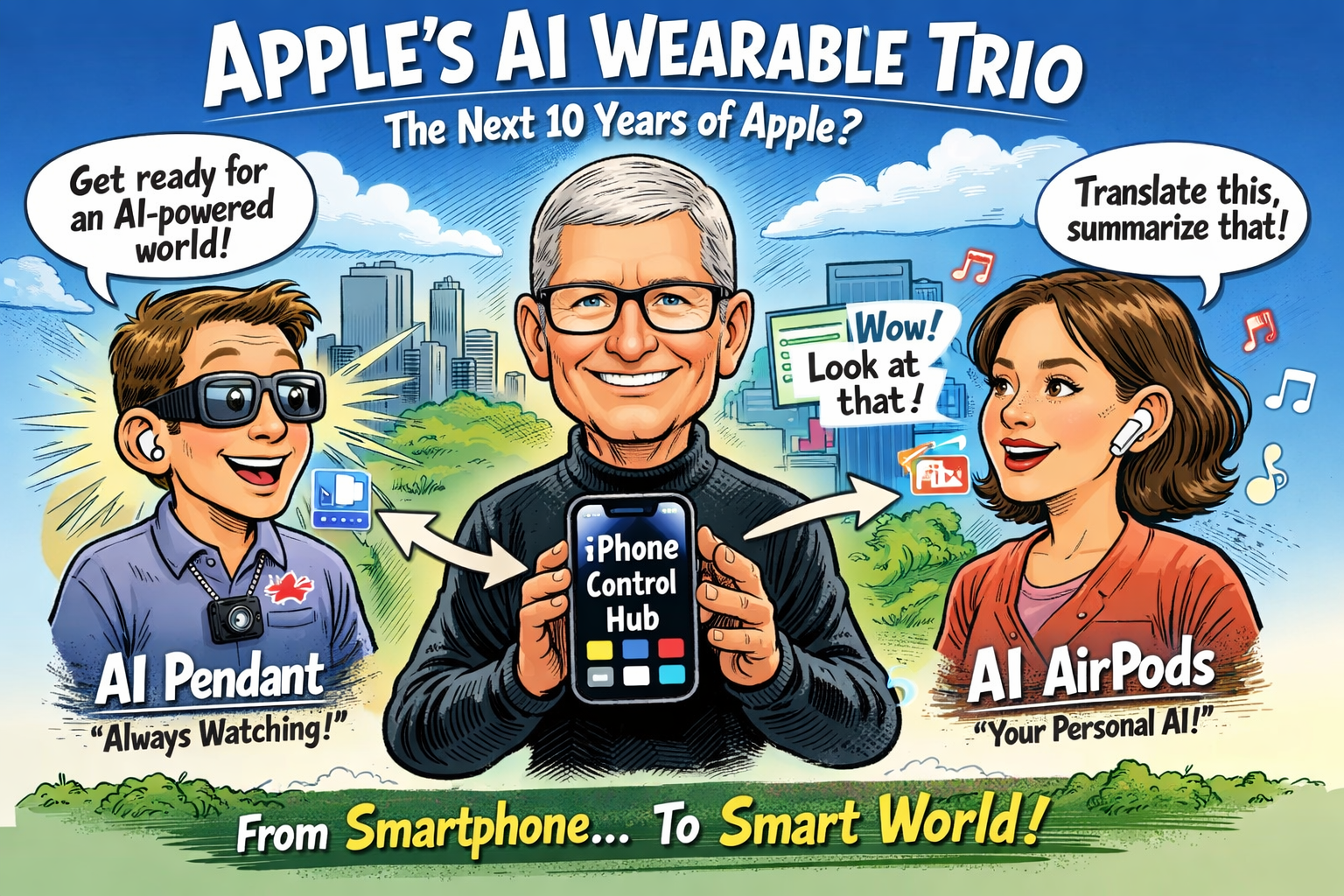

애플이 동시에 준비 중이라는 AI 웨어러블 3가지

Apple이 병렬로 개발 중이라는 장치는 세 가지야.

- 옷에 꽂는 AI 펜던트

- 코드네임 N50 스마트 글래스

- AI 기능 강화된 차세대 에어팟

공통 구조는 단순해. 아이폰을 허브로 두고, 몸 주변에 카메라·마이크·센서를 분산 배치하고, 음성 비서를 중심 인터페이스로 묶는 방식. 즉 기기 하나가 아니라 “주변 환경 전체를 입력 장치로 쓰는” 구조에 가까워.

AI 펜던트 — 항상 기록하는 개인 컨텍스트 센서

핀처럼 옷에 다는 초소형 장치 컨셉이야. 항상 전면 환경을 관찰하고, 그 데이터를 바탕으로 AI가 상황을 이해하는 구조.

이 포지션은 이미 여러 스타트업이 시도했지만 현실 장벽이 컸지.

- 발열

- 배터리

- 사용성

- 프라이버시

애플이 들어오면 달라질 수 있는 지점은 두 가지로 보여.

- 기존 서비스와 자연스럽게 연결되는 생태계 통합

- 온디바이스 처리 중심의 프라이버시 설계

결국 방향은 이렇게 읽혀. 항상 기록 → 자동 요약 → 필요할 때 검색

N50 스마트 글래스 — 일상형 AI 인터페이스

스마트 글래스는 현재 경쟁이 이미 시작된 영역이야. 특히 Meta와 Snap이 먼저 시장 반응을 확인한 상태. 이번에 알려진 핵심 포인트는 이거야.

- 고해상도 카메라 탑재

- 생산 일정이 구체화된 개발 단계

- 헤드셋보다 일상형 기기로 포지셔닝

무게감 있는 AR 헤드셋이 아니라, 항상 착용 가능한 생활형 장치가 메인 볼륨이 될 가능성이 높다는 신호로 읽혀.

AI 에어팟 — 귀에 꽂는 실시간 정보 레이어

이미 음성 인터페이스의 핵심 장치였던 에어팟에 본격적인 AI 기능이 얹히는 그림이야.

현실적으로 예상 가능한 사용 시나리오는 이런 쪽.

- 카메라가 본 장면을 음성으로 설명

- 회의 내용 실시간 요약

- 외국어 자동 통역

- 상황 기반 알림

핵심은 화면을 보지 않아도 정보 소비가 가능해진다는 점.

애플 전략의 본질 — 기기가 아니라 공간을 인터페이스로 만든다

지금 AI 시장은 크게 두 방향이야.

- 모델 중심 → OpenAI, Google 같은 클라우드·모델 경쟁

- 전용 디바이스 중심 → Humane 같은 AI 전용 장치 접근

애플은 중간 지점을 선택한 것처럼 보여.

- 기존 스마트폰을 허브로 유지

- 웨어러블을 센서 네트워크로 확장

- 개인 주변 공간 전체를 인터페이스화

정리하면, AI 기기 → AI 환경으로 확장하는 전략

서비스 기획자 관점에서 꼭 봐야 할 변화

이 흐름이 현실화되면 서비스 설계 방식 자체가 바뀔 가능성이 높아.

UI 중심 설계에서 → 컨텍스트 중심 경험 설계로 이동

앞으로 기본값이 될 요소들

- 시선 기반 인터랙션

- 음성 중심 피드백

- 상황 인식형 서비스

- 실시간 요약 인터페이스

- 프라이버시 설계 자체가 핵심 UX

특히 카메라 기반 웨어러블이 대중화되면 서비스는 화면 안이 아니라 사용자의 환경 속에 배치되는 개념으로 바뀔 가능성이 커.

핵심 한 줄 정리

스마트폰 다음 단계는 새로운 기기가 아니라 몸 주변 전체를 컴퓨팅 환경으로 만드는 방향